DirectSR : l’API de Microsoft qui doit rallier DLSS, FSR et XeSS |

————— 01 Mars 2024 à 16h09 —— 43918 vues

DirectSR : l’API de Microsoft qui doit rallier DLSS, FSR et XeSS |

————— 01 Mars 2024 à 16h09 —— 43918 vues

Ces derniers jours, vous avez peut-être vu passer des articles traitant du DirectSR de Microsoft. L’entreprise prévoit de présenter en détail ce que nous pensions être une technologie de mise à l’échelle le 21 mars prochain. Avant cette échéance, et afin d’éviter toute confusion, Microsoft a apporté quelques précisions par le biais d’un article de blog. La société y précise que le DirectSR n’est nullement une techno visant à supplanter celles existantes. Au contraire, il s’agit en fait d’une API pour DirectX qui doit servir à normaliser leur intégration.

Une préférence ? © TechPowerUp

Commençons par un résumé de la situation actuelle en matière de SR. De nos jours, les trois mastodontes que ce sont NVIDIA, AMD et Intel proposent tous leur propre technologie de mise à l’échelle.

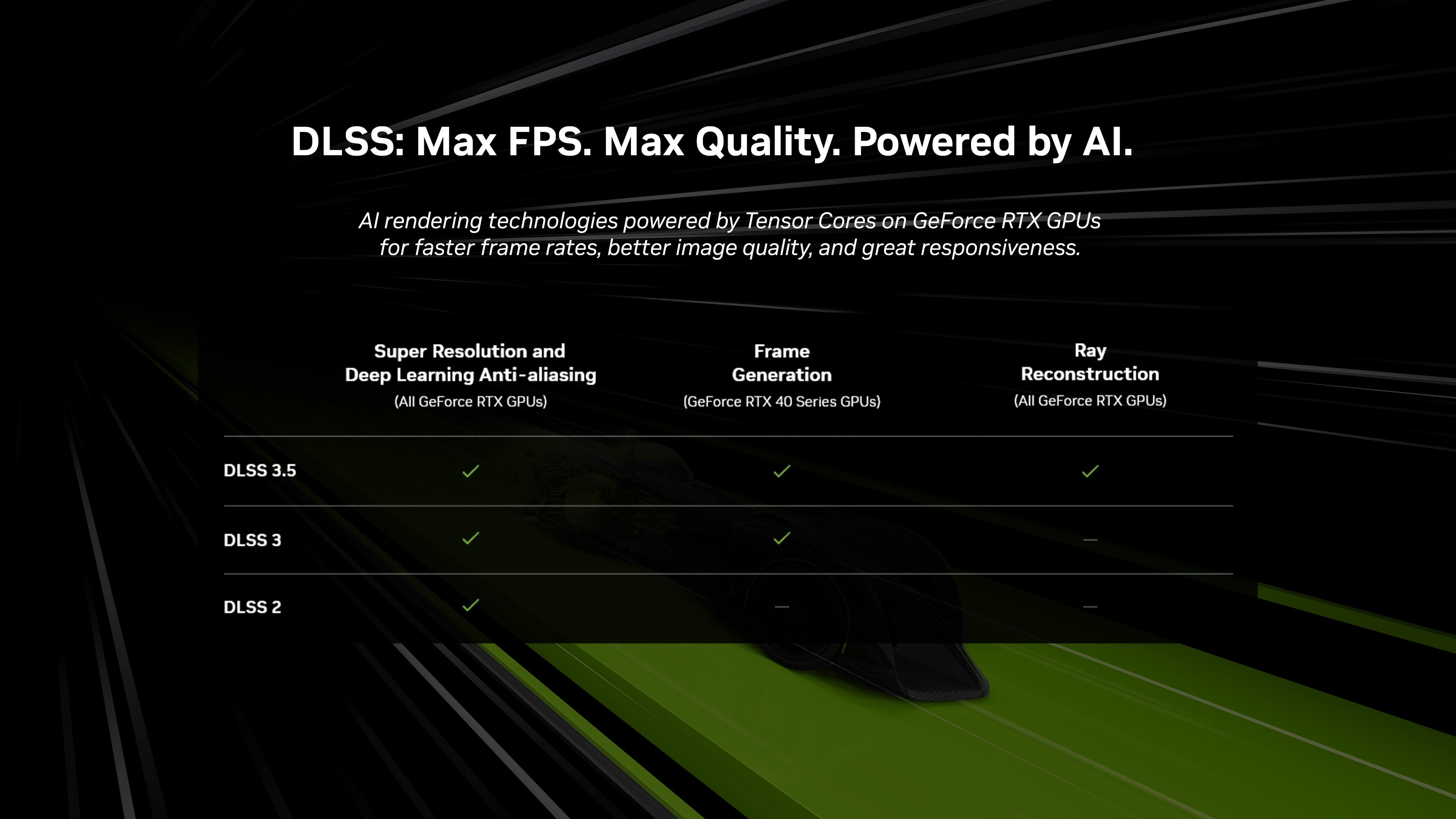

NVIDIA a dégainé la première, en 2018, avec son DLSS, à l’occasion du déploiement des GPU sous architecture Turing (GeForce RTX 20 Series). Particularité du Deep Learning Super Sampling : accéléré par l’IA, il est exclusif aux cartes graphiques GeForce dotées de cœurs Tensor. Le DLSS 2.0 a vu le jour en 2020. Deux ans plus tard, le DLSS 3 a accompagné la commercialisation des GeForce RTX 40 Series sous architecture Ada Lovelace et amorcé la guerre de la Frame Generation. Officiellement, nous en sommes au DLSS 3.5, version qui a intégré la ray reconstruction.

AMD avait répliqué en juin 2021 avec son FidelityFX Super Resolution 1.0 (FSR). Le FSR 2.0 a suivi l’année suivante. Le FSR 3.0 est arrivé en 2023, mais son implémentation reste encore assez marginale. Contrairement au DLSS de NVIDIA, le FSR n’a aucune trace d’IA ; open-source, la technologie est supportée par un large panel de cartes graphiques ; pas exclusivement celles d’AMD.

Enfin, en 2022, Intel s’est lancée à son tour dans la mêlée avec le XeSS, sigle de Xe Super Sampling. C’est une technologie à mi-chemin entre celle d’AMD et de NVIDIA : elle est universelle comme la première, mais exploite un matériel de machine learning dédié et des algorithmes d'IA pleinement exploités par les cœurs XMX (Xe Matrix eXtensions) des GPU Arc Alchemist.

Point commun de toutes ces technologies de mises à l’échelle : les développeurs doivent les implémenter manuellement dans leurs productions ; ce ne sont pas de simples surcouches gérées au niveau des pilotes graphiques. Forcément, intégrer les trois technologies d'upscaling une par une peut vite devenir fastidieux, au-delà des accords commerciaux. En témoigne l’exemple de Starfield : la production de Bethesda – partenaire d’AMD – proposait juste le FSR 2 lors de sa parution en septembre 2023. Le DLSS a été ajouté en novembre ; l’XeSS mais aussi le FSR 3 ont atterri dans la production seulement le mois dernier.

C’est là que le DirectSR entre en jeu. De plus amples informations seront communiquées à l’occasion de la GDC 2024 (Game Developers Conference) qui se déroula du 18 mars au 23 mars. Mais en l’état, Microsoft présente son API comme le fruit d’une collaboration entre les différents acteurs du secteur (les trois susmentionnés) qui va permettre de faciliter l’intégration des différentes technologies de mise à l’échelle temporelle dans les jeux. Il est ainsi question « de réaliser des SR multi-fournisseurs grâce à un ensemble commun d'entrées et de sorties, permettant d'activer une variété de solutions telles que NVIDIA DLSS Super Resolution, AMD FidelityFX Super Resolution, et Intel XeSS via un seul cheminement de code ».

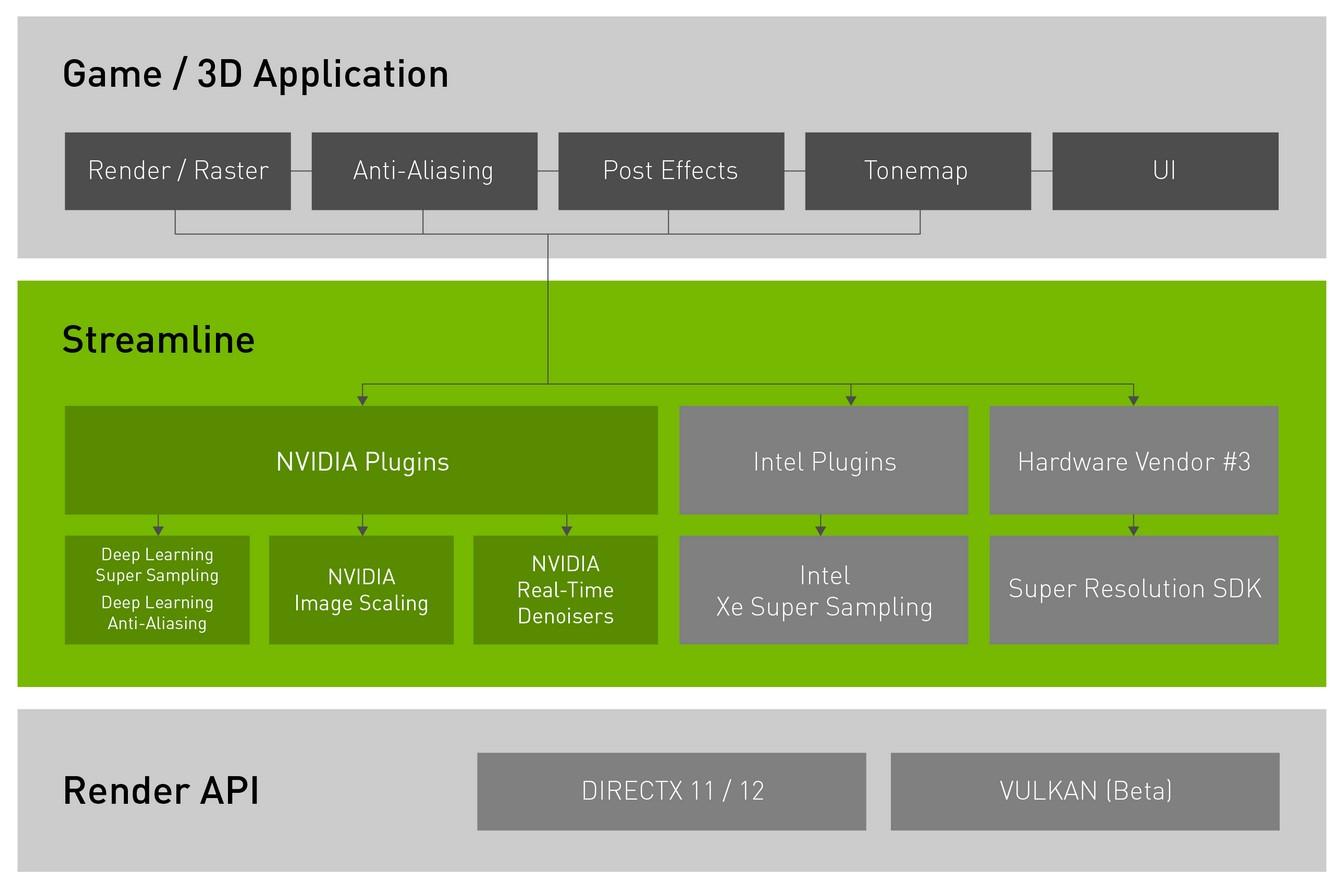

Ce projet rappelle peut-être à certains d’entre vous le NVIDIA Streamline. Un framework open source qui devait permettre aux développeurs d'implémenter facilement des technologies de super-résolution concurrentes. AMD n’a jamais rejoint cette initiative qui semble désormais lettre morte. Elle devait prendre en charge DirectX 11, DirectX 12 et Vulkan.

Streamline © NVIDIA

A priori, avec son DirectSR, Microsoft est parvenue à concrétiser cette ambition. Nous en apprendrons davantage d’ici une vingtaine de jours. Ci-dessous, vous pouvez consulter l’intégralité du texte de présentation publiée par Joshua Tucker dans l'article titré DirectX Innovation on Display at GDC 2024.

« Nous sommes ravis d'annoncer DirectSR, notre nouvelle API conçue en partenariat avec les fournisseurs de matériel GPU pour permettre l'intégration transparente de la Super Résolution (SR) dans la prochaine génération de jeux. La super résolution est une technique de pointe qui augmente la résolution et la qualité visuelle des jeux. DirectSR est le chaînon manquant que les développeurs attendaient pour l'intégration de la SR, en offrant une expérience plus fluide et plus efficace qui s'adapte à tous les types de matériel. Cette API permet de réaliser des SR multi-fournisseurs grâce à un ensemble commun d'entrées et de sorties, permettant à un seul chemin de code d'activer une variété de solutions telles que NVIDIA DLSS Super Resolution, AMD FidelityFX Super Resolution, et Intel XeSS. DirectSR sera bientôt disponible dans le SDK Agility en tant qu'aperçu public, ce qui permettra aux développeurs de le tester et de faire part de leurs commentaires. Ne manquez pas notre DirectX State of the Union à la GDC pour découvrir en avant-première comment DirectSR peut être utilisé dans vos jeux ! »

| Un poil avant ?Test • PCSpecialist Fusion 14 | Un peu plus tard ...Jusqu'à 100 € de cashback sur les Radeon 7000 Asus, bonne affaire en vue |  |