Samsung optimise sa HBM4E pendant que NVIDIA revoit ses ambitions pour la HBM4 de Vera Rubin |

————— 04 Mars 2026 à 18h20 —— 17343 vues

Samsung optimise sa HBM4E pendant que NVIDIA revoit ses ambitions pour la HBM4 de Vera Rubin |

————— 04 Mars 2026 à 18h20 —— 17343 vues

Cela fait une quinzaine de jours que Samsung a annoncé le lancement de la production de sa HBM4. Cette mémoire, pour laquelle le constructeur coréen est face à SK hynix et Micron, doit notamment équiper les GPU Rubin de NVIDIA. Selon SemiAnalysis (via Jukan05 sur X), NVIDIA aurait revu un peu ses exigences à la baisse. Dans le même temps, un article de Hankyung expose comment Samsung répond aux défis de la HBM4E.

L’objectif initial de NVIDIA pour le système VR200 NVL72 « Vera Rubin » était de 13 To/s en mars 2025. Il avait été porté à 20,5 To/s en septembre dernier. Lors du CES 2026, la firme a encore augmenté la mise, en visant 22 To/s. Surenchère peut-être liée aux 19,6 To/s de l’accélérateur AMD Instinct MI455X.

IMPORTANT: At CES 2026 this week, NVIDIA revised their VR200 NVL72 Spec to overtake by 10% the Memory Bandwidth Advantage from AMD's MI455X. AMD MI455X is 19.6TB/s while Jensen announced in March 2025 Rubin will be 13TB/s and then in September 2025 Ian Buck announced that Rubin… pic.twitter.com/kyzkV4cSPO

— SemiAnalysis (@SemiAnalysis_) January 19, 2026

Cependant, les fournisseurs peineraient à garantir ce seuil en pratique. D’après SemiAnalysis, la vitesse effective de la HBM4 pour le système « Vera Rubin » sa situera plutôt autour de 20 To/s, soit environ 10 Gbit/s par pin. Pour comparaison, Samsung a revendiqué 11,7 Gbit/s pour sa HBM4, avec une perspective de 13 Gbit/s à terme.

SK Hynix Has a Plan for HBM4 'Performance Jump'… Pursuing New Packaging Technology

— Jukan (@jukan05) March 3, 2026

SK Hynix is seeking a transformation in packaging technology for High Bandwidth Memory (HBM). The company has devised a technology that can enhance HBM stability and performance without a major… pic.twitter.com/WBzyUFemFy

En passant, notre article du 13 février, basé sur un rapport de TrendForce, mentionnait un écosystème à trois fournisseurs pour la HBM4 chez NVIDIA. Quelques jours plus tôt, SemiAnalysis avait toutefois écarté Micron des VR200 NVL72, faute de preuve de son implication. Selon cette source, SK hynix fournirait 70 % de la HBM4, le reste revenant à Samsung.

SemiAnalysis: We reduce Micron’s $MU share of Nvidia Rubin HBM to zero. We currently do not see indications of Nvidia ordering Micron HBM. We expect Nvidia’s HBM4 supply to consolidate SK Hynix and Samsung at a 70/30 split.

— Wall St Engine (@wallstengine) February 6, 2026

Quelques recherches montrent que ces informations ont été validées par certains acteurs, mais réfutées par d’autres. Bref, les racontars sont assez contradictoires.

Pour ceux qui ne le savent pas, la base die HBM4 de Micron a de gros soucis de design et est d’ailleurs en train d’être revue. L’ancienne version ne passe pas les test de qualification d’Nvidia donc normal que sa pdm chez Nvidia soit de 0.

— Julien | Tech & Invests (@JulienTechInvst) February 6, 2026

C’est notamment pour cette raison que… https://t.co/pckq7W8MuE

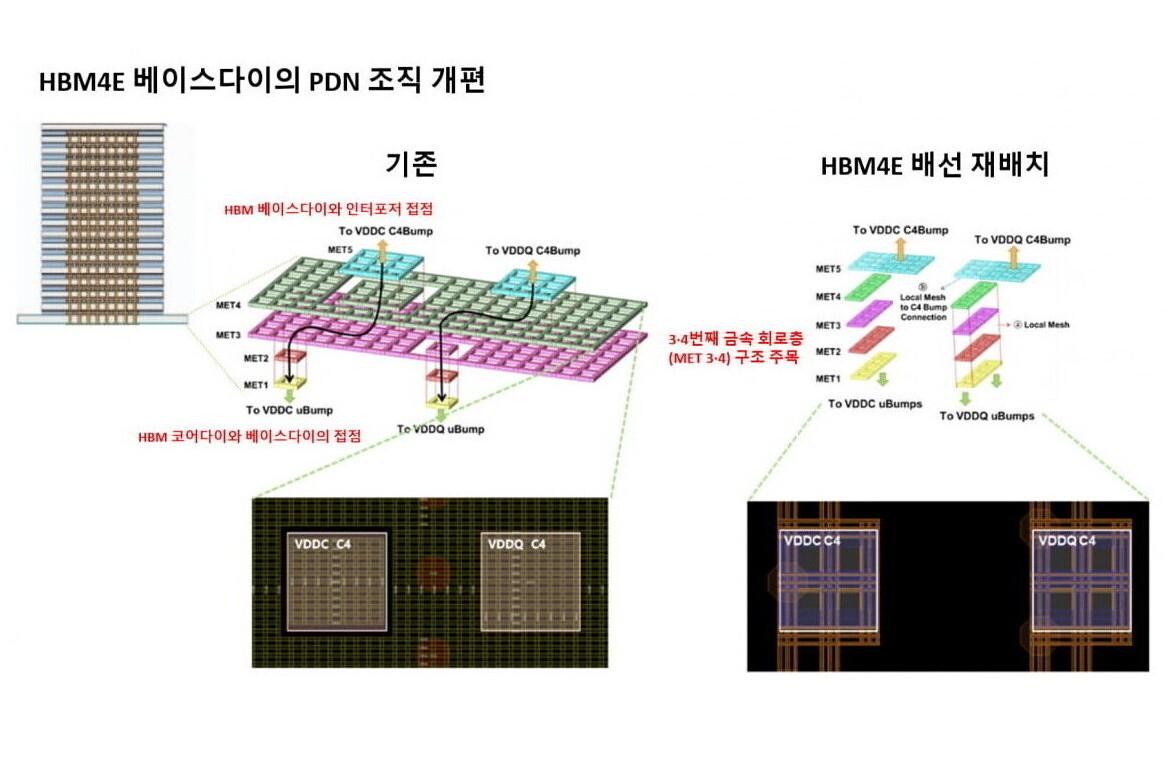

Dans un autre registre, TrendForce relaie un article de Hankyung détaillant la manière dont Samsung œuvre sur sa HBM4E. Le réseau d’alimentation sera réorganisé pour gérer 14 457 points d’alimentation, contre 13 682 précédemment, tout en restant dans le même espace. Cela implique donc un câblage plus fin et plus dense. Cette densité accrue risque d'entraîner une résistance plus importante et des chutes de tension (IR drop), donc de nuire aux performances.

Pour y remédier, l'article explique que Samsung a révisité le réseau d’alimentation. Le bloc MET4, auparavant centralisé sur la puce et disposé en larges sections en nid d’abeille près de l’interposer, a été découpé en quatre segments plus petits, tandis que les couches supérieures ont été morcelées pour réduire la congestion et raccourcir les trajets électriques. Aux dires de la principale concernée, ces modifications réduisent les défauts métalliques de 97 % par rapport à la HBM4 et améliorent l’IR drop de 41 %, offrant plus de marge de tension, des vitesses accrues et une fiabilité renforcée.

© Hankyung

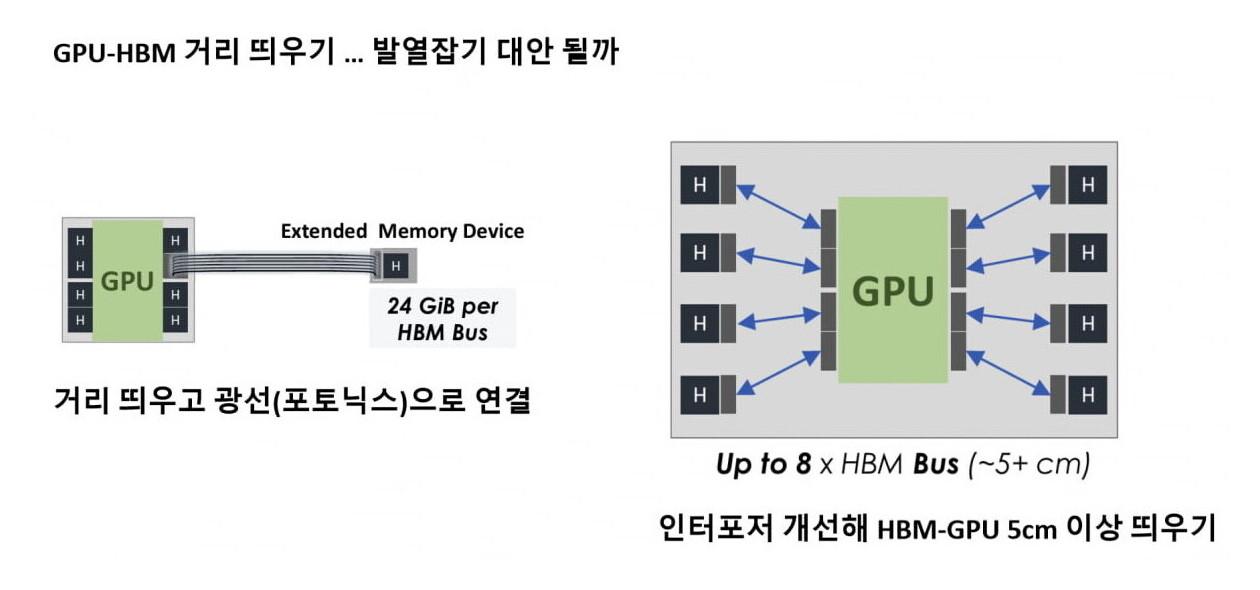

Enfin, Samsung explore la possibilité de séparer physiquement la HBM du GPU. Pour cela, l’entreprise mise sur des interconnexions photoniques, donc capables de transmettre les données à des vitesses de l’ordre du térabit par seconde (environ 1 000 fois plus rapide que le cuivre) et ainsi compenser l’allongement des distances. Selon Samsung, les progrès dans le câblage des substrats pourraient permettre de placer la HBM et le GPU à plus de 5 cm l’un de l’autre, contribuant ainsi à mieux gérer la chaleur générée par un empilement dense des composants.

© Hankyung

| Un poil avant ?EA va porter Javelin Anticheat sur Windows-on-Arm et évoque un support Linux | Un peu plus tard ...La GeForce RTX 3060 de retour et la RTX 5050 affublée de GDDR7 ? |  |