Marvell présente sa CHBM, de la HBM en mieux |

————— 12 Décembre 2024 à 17h20 —— 25078 vues

Marvell présente sa CHBM, de la HBM en mieux |

————— 12 Décembre 2024 à 17h20 —— 25078 vues

À l’occasion de son Analyst Day 2024, Marvell a officialisé sa CHBM (custom high-bandwidth memory) Compute Architecture. C'est une plateforme conçue pour les XPU spécialisés dans les applications IA de la société. Elle est développée en collaboration avec Micron, Samsung, et SK hynix, stipule le communiqué de presse ; mais en dehors d’une norme JEDEC pour le moment.

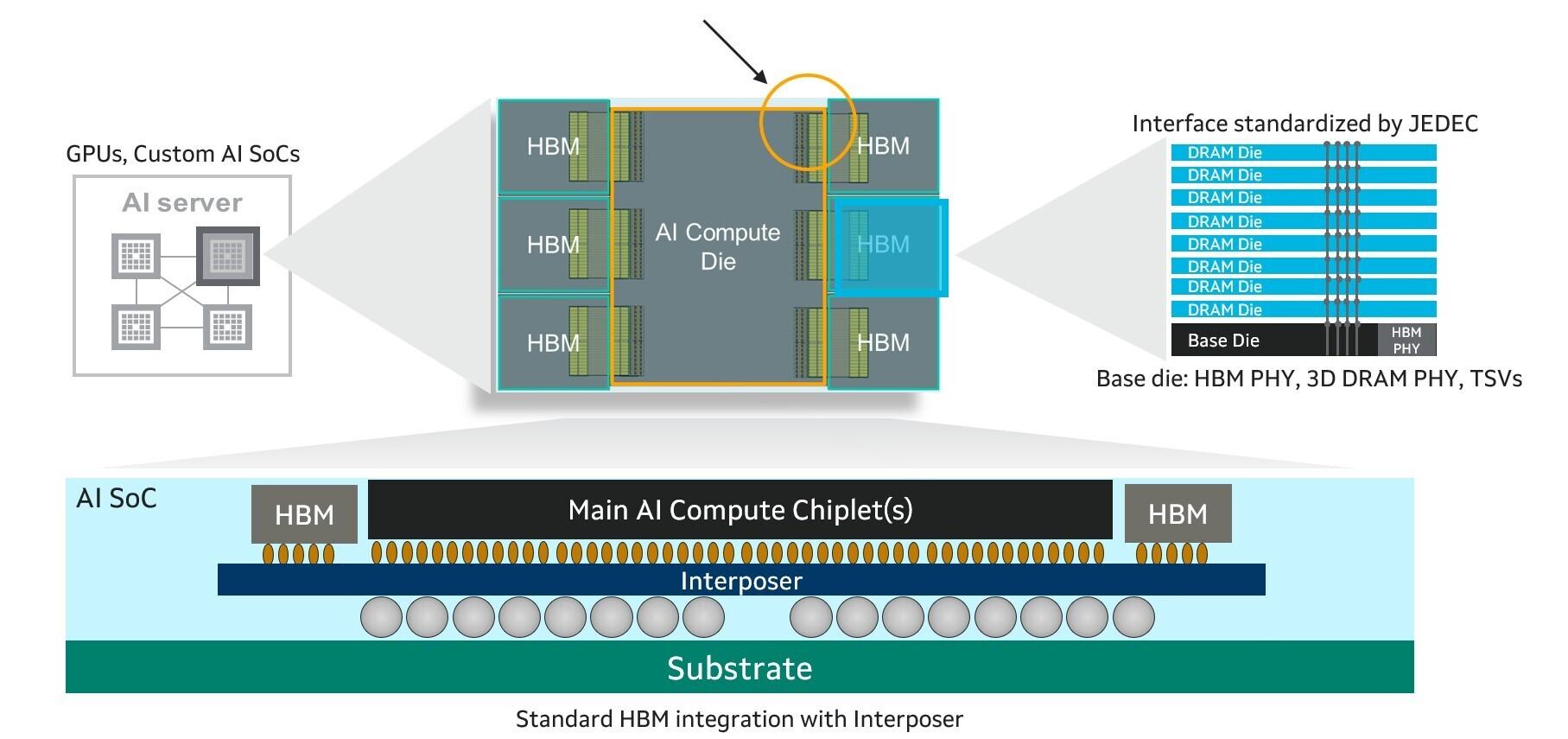

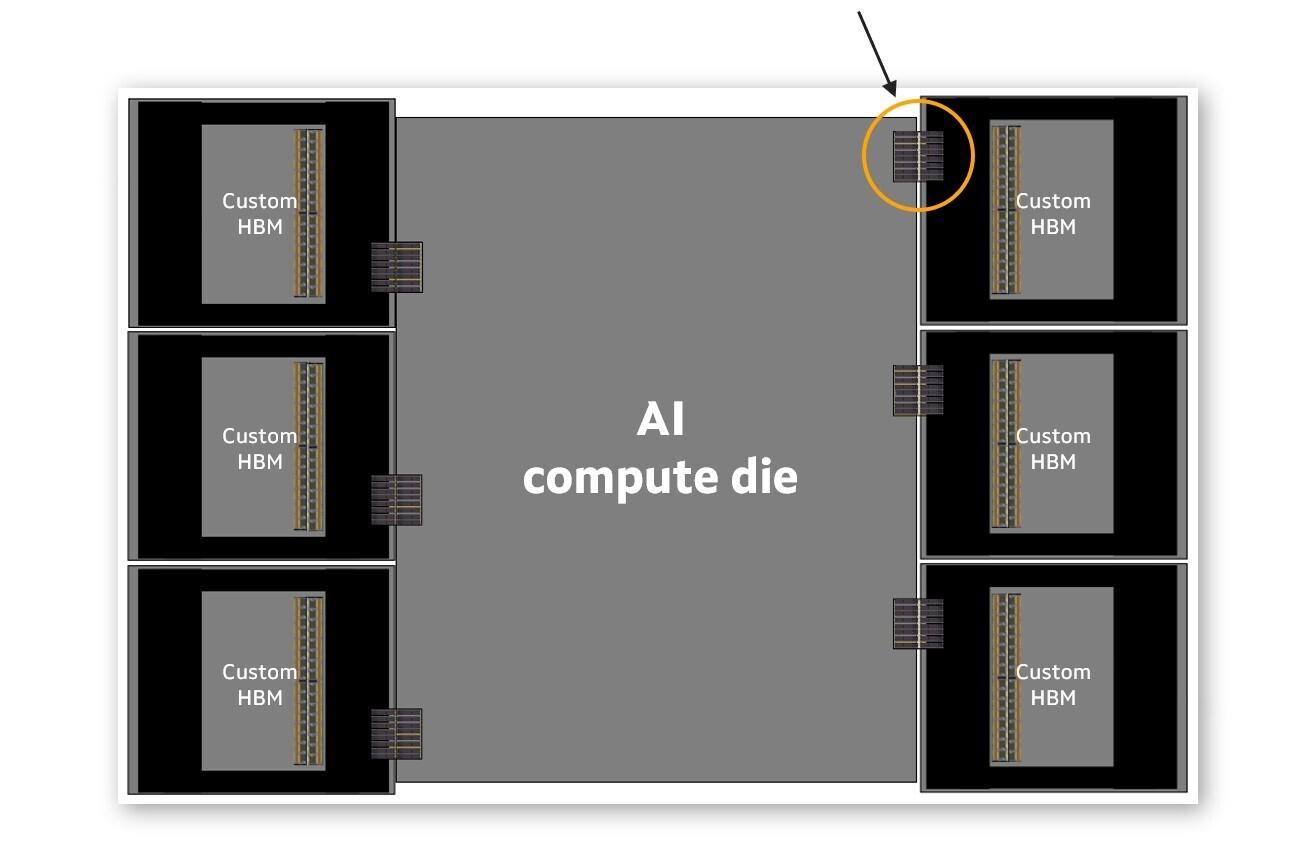

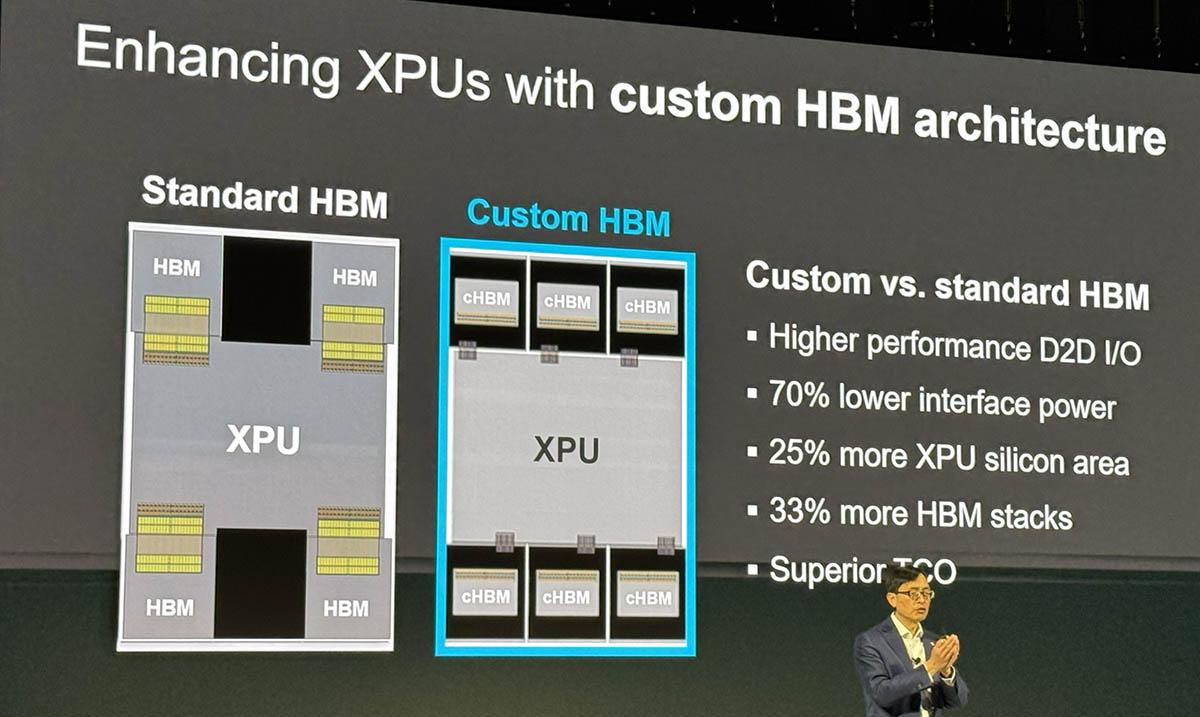

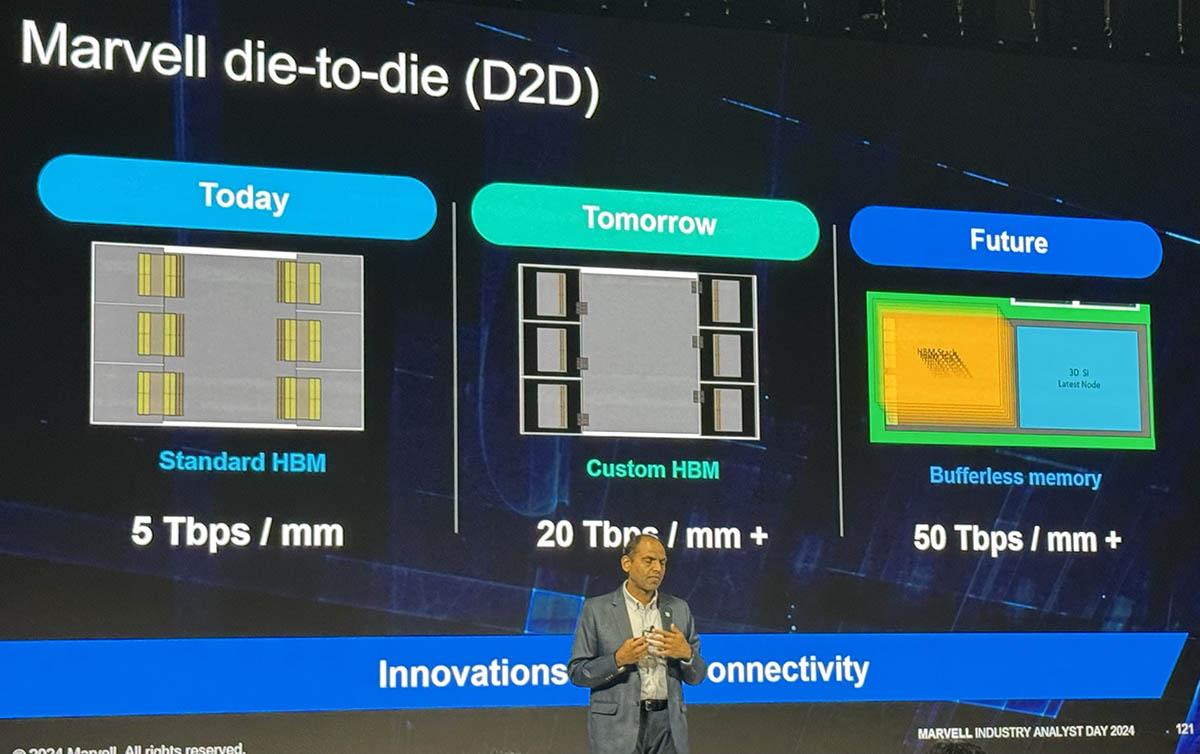

Il y a encore peu de détails, mais ServeTheHome a publié plusieurs diapositives de la présentation de cette interface die-to-die I/O propriétaire. Marvell asserte avoir réduit la surface occupée au sein même des puces par rapport aux interfaces HMB standards.

D’après la diapositive qui suit et les infos du communiqué, cette conception accroît de 25 % la surface pour le silicium des XPU, réduit la consommation d'énergie de l'interface mémoire de 70 % et permet d’installer 33 % de stacks mémoire HBM en plus à côté des chiplets de calcul.

Une autre diapositive évoque une bande passante die-to-die de 20 Tbits/mm (environ 2,5 To /s par mm) pour la CHBM, contre 5 pour la HBM standard (environ 625 Go/s). À terme, Marvell table sur 50 Tbits/mm (soit 6,25 To/s par mm).

« En personnalisant le sous-système de mémoire HBM, y compris la pile elle-même, Marvell fait progresser la personnalisation de l'infrastructure des centres de données en nuage. Marvell collabore avec les principaux fabricants de mémoire HBM pour mettre en œuvre cette nouvelle architecture et répondre aux besoins des opérateurs de centres de données cloud », pouvons-nous lire dans le communiqué.

Comme l’écrit notre confrère de ServeTheHome en conclusion de son article, le fait que Marvell s’engage dans cette voie signifie qu’elle est en bonne position pour remporter plusieurs contrats pour ses XPU dans les centres de données IA, car ce type de personnalisation de la mémoire ne peut être viable sur de petites commandes (en tant que norme non spécifiée par le JEDEC, elle implique, sur le plan matériel, un contrôleur et une interface physique custom, des dies HBM révisés, etc.).

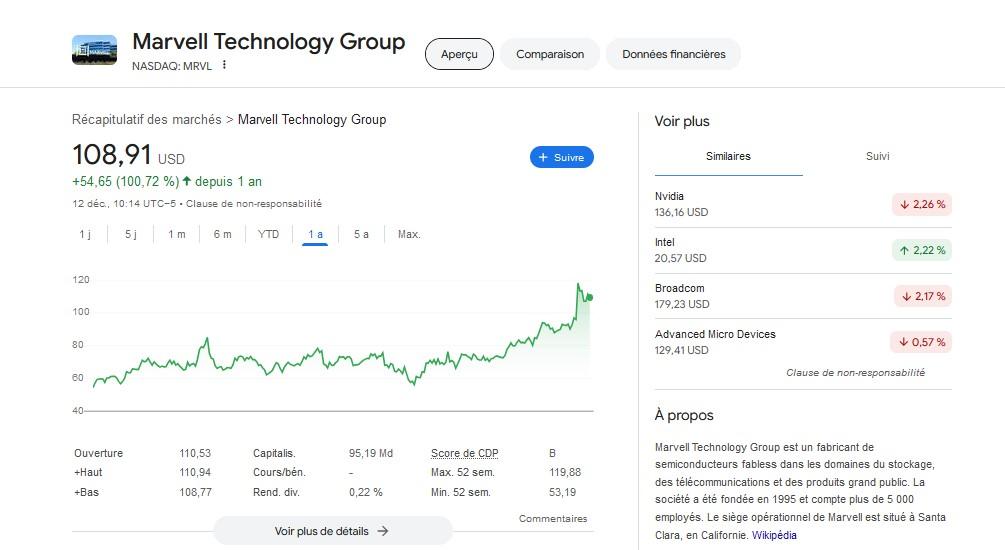

Nous verrons, mais financièrement, l’entreprise a le vent en poupe. En témoigne le cours de son action, passé d’une soixante de dollars en décembre 2023 à 111,36 dollars actuellement.

Parmi les nombreuses déclarations de partenaires qui ponctuent le CP, nous avons retenu celle de Patrick Moorhead, PDG et fondateur de Moor Insights & Strategy (traduction automatique via Deepl) :

Les XPU personnalisés offrent des performances et un rendement par watt supérieurs à ceux des solutions générales du marché pour des charges de travail spécifiques et propres au cloud. Marvell, qui est déjà un acteur du silicium informatique personnalisé, fournit déjà des solutions sur mesure aux principales sociétés de cloud computing. Sa dernière plateforme d'architecture HBM pour le calcul personnalisé constitue un levier supplémentaire pour améliorer le coût total de possession du silicium personnalisé. Grâce à une collaboration stratégique avec les principaux fabricants de mémoire, Marvell est en mesure d'aider les opérateurs de cloud à faire évoluer leurs XPU et leur infrastructure accélérée, leur ouvrant ainsi la voie vers l'avenir de l'IA. »

| Un poil avant ?Le NH-P1 tente de refroidir passivement le Ryzen 9 9950X | Un peu plus tard ...L'émulateur RPCS3 embrasse l’arm64 et s’aventure sur Raspberry Pi 5 |  |